[vc_row][vc_column width=”1/2″][vc_column_text]

Dieser Blogeintrag ist ein Teil unserer Arbeit für das zweite White Paper des Competence Circle Technologie, Innovation und Management – kurz #ccTIM.

[/vc_column_text][/vc_column][vc_column width=”1/2″][vc_column_text]

#ccTIM ist einer der 10 Competence Circles vom Deutschen Marketing Verband #DMV.

Unsere Competence Circle Mitglieder sind Mitglieder von Marketing Clubs aus ganz Deutschland.

[/vc_column_text][/vc_column][/vc_row][vc_row][vc_column][vc_column_text css=”.vc_custom_1511164608508{margin-bottom: 0px !important;}”]

Dieser Beitrag ist der erste in einer Serie auf dem MCLago Blog und Blogs von Mitgliedern des Competence Circle Technologie, Innovation und Management – kurz #ccTIM.

- AI: What makes a system expert?

- Was ist künstliche Intelligenz (KI)? (sie sind hier)

Intro

Künstliche Intelligenz (KI, englisch Artificial Intelligence – AI) ist in aller Munde. Schon seit Jahren behauptet sich die Technologie in einschlägigen Trend-Reports auf den ersten Plätzen (siehe z.B. Gartner Technology Trends). Bisherige Ansätze der “Big Data” oder “Analytics” reichen da schon lange nicht mehr aus. Nicht zuletzt treiben die großen Technologiefirmen mit Aufsehen erregenden Beispielen die Erwartungen selbst voran. Öffentlichkeitswirksamste Highlights der letzten Jahre waren dabei insbesondere:

- DeepMind’s (Google) AlphaZero ist innerhalb von 24 Stunden zum stärksten Go- Spieler der Welt geworden – eine Leistung, die noch kurz zuvor für das Jahr 2027 prognostiziert worden war. Zum stärksten Schach-Spieler der Welt hat AlphaZero etwa vier Stunden Training benötigt (Empfehlung: AlphaGo Movie; Wikipedia)

- Google’s Duplex erledigt eigenständig einfache Anrufe und ist vom Menschen am Telefon nahezu nicht mehr unterscheidbar (Unbedingt anhören auf YouTube)

- Uber, Waymo (Google) & Co sowie einige europäische Firmen (z.B. Deutsche Bahn, Volvo) starten die ersten öffentlichen Feldtests ihrer autonomen Flotten und lassen wenig Zweifel daran, dass dies die Zukunft der Mobilität ist

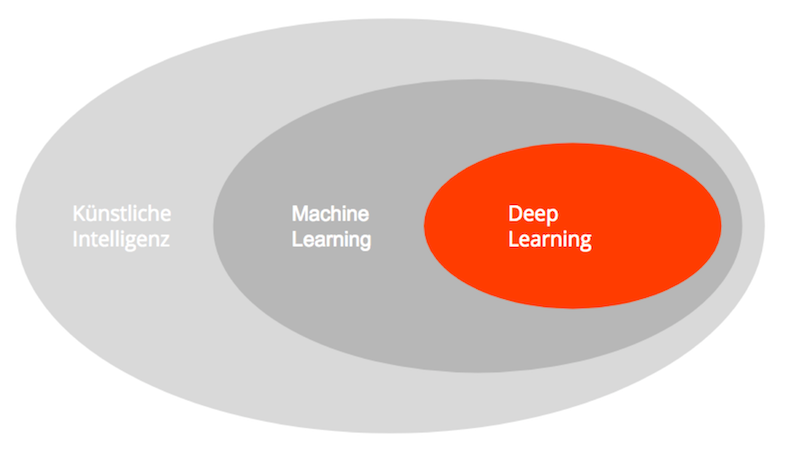

Die Technologie, die maßgeblich hinter den oben genannten und unzähligen weiteren Innovationen steckt, heißt Deep Learning und ist ein Teilgebiet der KI.

In diesem ersten Blogpost möchten wir die relevanten Konzepte und Begriffe möglichst verständlich erklären und allen Lesern so einen Weg durch den Buzzword- Dschungel hin zu den relevanten Anwendungsfällen ebnen. Geplant sind weitere Blogposts zum Thema KI, in denen wir uns mit eben diesen Use Cases sowie der Frage, was es zum erfolgreichen Einsatz von KI in Unternehmen neben Data Scientists eigentlich noch benötigt, widmen möchten.

Abbildung 1 zeigt, wie sich KI und Deep Learning voneinander angrenzen. Im Folgenden gehen wir auf die Themenfelder Künstliche Intelligenz, Machine Learning und Deep Learning explizit ein.

Künstliche Intelligenz (KI)

KI beschreibt allgemein die Fähigkeit von Computern bzw. Maschinen, intelligent zu sein bzw. zu handeln. Mit “intelligent” können hier eine Vielzahl an Fähigkeiten gemeint sein, darunter: Lernen, Planen, kreativ sein, logisch denken, Probleme lösen, schlussfolgern, verstehen oder sogar sich selbst wahrnehmen. Wenn eine Maschine die meisten dieser genannten Eigenschaften vereint und für beliebige Aufgaben eingesetzt werden kann, gilt sie als starke KI (engl. “strong AI” oder “general AI”). Auch wenn die Darstellung von KI in Filmen meistens der einer starken KI entspricht (vgl. Terminator, I, Robot, Her), ist eine solche Technologie aktuell nicht im entferntesten absehbar (Lesetipp dazu: Alan Winfield in The Guardian).

Alle heute bekannten und eingesetzten KIs sind sogenannte schwache KIs: Sie lösen ein sehr spezielles Problem in einer speziellen Domäne. Die gute Nachricht:

Mit den heute verfügbaren Algorithmen und Methoden lassen sich bereits ein Großteil der relevanten Herausforderungen in Unternehmen lösen.

Um zu verstehen, warum die Technologie gerade jetzt ihren ersten großen “Sommer” erlebt, lohnt sich ein kurzer Blick in die Geschichte: Der relevante Startschuss für KI war auf einer Konferenz unter Wissenschaftlern verschiedener Fachrichtungen im Jahr 1956 (Wikipedia). Schnell folgten erste Erfolge, z.B. durch einfache Brettspiel-Computer, die Erwartungen schossen in die Höhe (“Within a generation … the problem of creating ‘artificial intelligence’ will substantially be solved.”, Marvin Minsky, 1967) und wurden nicht im entferntesten erfüllt:

Es folgte der erste KI Winter in den 70ern (Wikipedia), in dem die meisten großen Forschungs- und Entwicklungsprojekte komplett eingestellt wurden. Nach einem weiteren Hoch mit wieder überzogenen Erwartungen in den 80ern (Fokus Expertensysteme), folgte der zweite KI Winter in den 90ern. Mit dem Begriff KI konnte man sich fortan auf Konferenzen nicht mehr blicken lassen, die Forschung fand trotz einiger bemerkenswerter Fortschritte (siehe z.B. Deep Blue, DARPA Challenges, Watson bei Jeopardy!) größtenteils unter dem Deckmantel der Informatik statt.

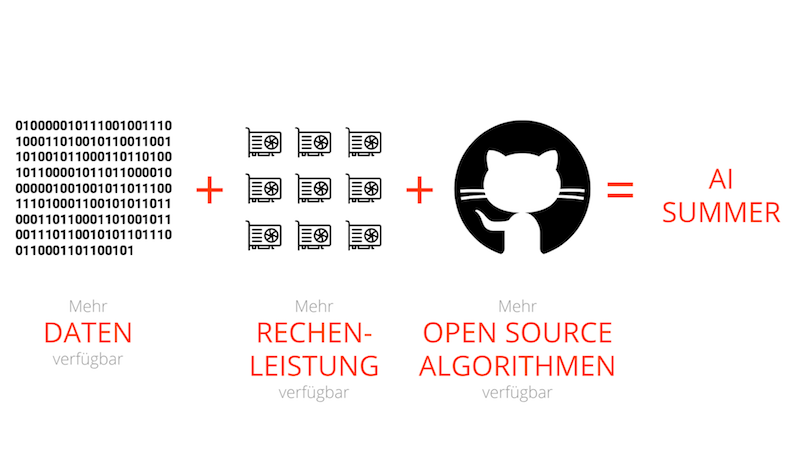

In den letzten 5-10 Jahren gab es allerdings eine erstaunliche und rasante Renaissance der KI, allem voran in dem Teilgebiet Deep Learning. Die zugrunde liegenden Technologien (hauptsächlich Neuronale Netzwerke) sind zwar schon seit den 1960er Jahren bekannt, drei wesentliche Hebel machen sie aber erst seit kurzer Zeit so erfolgreich einsetzbar:

Daten

Daten sind der Treibstoff aller Algorithmen und lernenden Systeme. Durch den andauernden Big Data Hype ab Mitte der 2000er, die ständig wachsende Anzahl an sich mitteilender Personen (Social Media) und Objekten (IoT) und die durch das Internet geschaffene ortsunabhängige Datenverfügbarkeit, wächst die Menge an verfügbaren Inputdaten rasant.

Rechenpower

Vor nicht allzu langer Zeit mussten für aufwändige Rechenoperationen kostenintensive Rechencluster gemietet oder sogar eigene Hardware angeschafft werden. Heute ist dank vieler großer Cloud-Anbieter (AWS & Co) und entsprechender Technologien (Hadoop & Co) nahezu beliebige Rechenpower mit wenigen Mausklicks verfügbar. Durch die Nutzung von Grafikprozessoren (GPUs = Graphic Processing Units) und inzwischen sogar dedizierter KI-Hardware (z.B. TPUs = Tensor Processing Units) können Deep-Learning- Algorithmen zusätzlich bis zu 30x beschleunigt werden.

Open-Source-Algorithmen

Künstliche Intelligenz/Deep Learning ist eines der weltweit aktivsten und am besten finanzierten Forschungsfeldern, es werden in erstaunlicher Geschwindigkeit neue bzw. verbesserte Algorithmen gefunden und getestet. Die großen öffentlichen und privaten Forschungseinrichtungen stellen dabei einen Großteil ihrer Forschungsergebnisse und den zugehörigen Programmcode (z.B. “GAFAA”: Google, Apple, Facebook, Amazon, Alibaba) unter Open Source Lizenzen zur Verfügung. Durch diese Open Innovation Strategie skaliert quasi die gesamte Forschung und die neuesten Technologien sind jederzeit und für jeden weltweit verfügbar.

Machine Learning (ML)

Machine Learning (dt. maschinelles Lernen) ist ein Teilgebiet der KI und beschäftigt sich mit der Erkennung von Mustern in Daten und darauf basierenden Vorhersagen. Neben dem Machine Learning gibt es viele weitere Teilgebiete der KI, z.B. intelligente Agenten, Expertensysteme, Suchalgorithmen, Evolutionäre Algorithmen oder Robotik. Eine allgemein gültige Definition oder scharfe Abgrenzung der Teilgebiete ist nicht immer möglich und auch nicht unbedingt notwendig – so gibt es aktuell den Trend, für konkrete KI-Lösungen verschiedene Teilgebiete miteinander zu kombinieren.

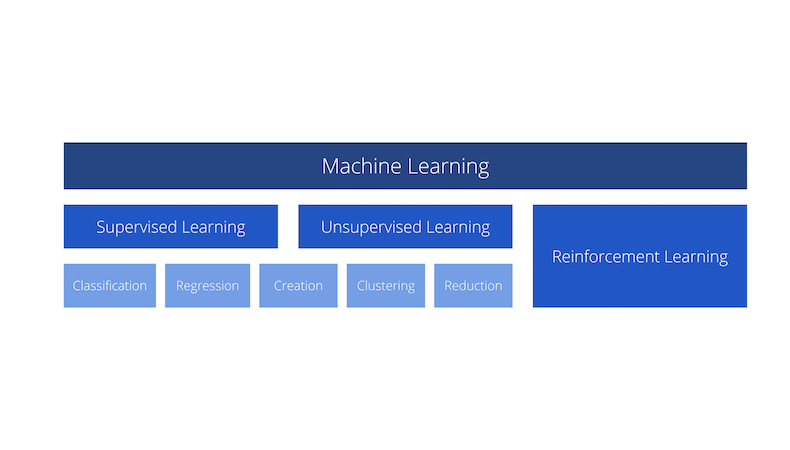

Machine Learning lässt sich, wie in Abbildung 3 dargestellt, grob in drei Teilgebiete unterteilen: Supervised Learning, Unsupervised Learning, Reinforcement Learning. Auch hier gibt es keine scharfe Trennlinie, aber in der Praxis ist es oft sehr hilfreich sich schon zu Beginn der Lösungsfindung zu überlegen, mit welcher Art des Problems man es gerade zu tun hat.

Abbildung 3: Teilgebiete des Machine Learning

Supervised Learning

- Bei einem Supervised Learning Problem (dt. überwachtes Lernen) soll eine Funktion f(x) = y gelernt werden, wobei x die Inputdaten darstellt und y das Target (Zielwert). Zum Lernen der Funktion stehen (eine große Menge) Beispieldatensätze x zur Verfügung, bei denen das Target y schon bekannt ist (historische Daten).

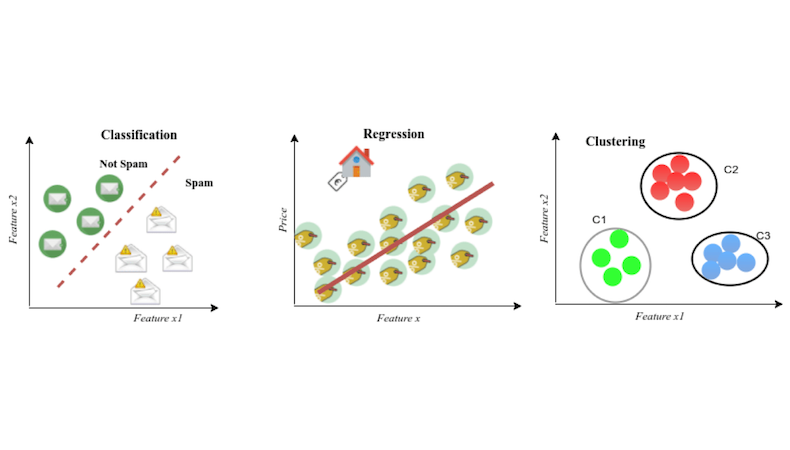

- Supervised Learning lässt sich vor allem zur Regression (Vorhersage von kontinuierlichen Werten) und zur Klassifikation (Vorhersage einer Kategorie) verwenden.

- Beispiel Regression: Vorhersage von Immobilienpreisen (Target y) anhand bestimmter Eigenschaften der Immobilien (Input x, z.B. Anzahl Zimmer, Quadratmeterzahl, Lage etc.). Zum Training werden bereits erzielte Erlöse aus Immobilienverkäufen (y) und die zugehörigen Eigenschaften der Immobilien (x) benötigt.

- Beispiel Klassifizierung: Einteilung von Mails in Spam vs. kein Spam (y=0: kein Spam, y=1: Spam) anhand des Mail-Inhalts, Absendeadresse etc. (x). Auch hier werden zum Training historische Daten über Mails, deren Inhalt und die Einteilung Spam/kein Spam benötigt.

Unsupervised Learning

- Bei einem Unsupervised Learning Problem (dt. unüberwachtes Lernen) sind nur die Inputdaten x gegeben, aber kein Zielwert (y). Der Algorithmus soll nützliche Strukturen/Muster des Datensatzes eigenständig erkennen bzw. erlernen.

- Unsupervised Learning wird meist zur Clusterbildung (finde Cluster mit ähnlichen Eigenschaften) oder Reduktion (finde eine Teilmenge des Datensatzes, welcher die ursprünglichen Daten ausreichend gut darstellt; z.B. zur Datenkompression) verwendet.

- Beispiel Clusterbildung: Gegeben Kundendaten (x: demographische und geographische Daten, Kaufverhalten etc.) werden die Kunden automatisch in passende Cluster/Personas eingeteilt. Auf dieser Basis können weitere Cluster-spezifische Entscheidungen (z.B. gezieltes Marketing) gesteuert werden.

Ein interessantes und aktuell sehr aktives Forschungsfeld ist das Erzeugen (“Creation”) von Daten, die Methoden sind oft ein Mix aus Supervised und Unsupervised Learning. Beispielsweise lassen sich Vogel-Bilder anhand einer textuellen Beschreibung des Vogels erzeugen: YouTube.

Reinforcement Learning

- Beim Reinforcement Learning lernt ein sogenannter Agent, Aufgaben in einer dynamischen Umgebung zu lösen. Dabei das Ziel klar vorgegeben und der Agent erhält bei jeder Aktion ein Feedback, ob die Aktion dem Ziel genutzt hat oder nicht.

- Die bekanntesten Beispiele des Reinforcement Learnings stammen von Computerspiel-Agenten, z.B. für Atari-Spiele (YouTube), Super Mario (YouTube), AlphaGo oder Dota (YouTube). Die Agenten bekommen dabei lediglich eine Zielfunktion (Super Mario: Anzahl Goldmünzen) und die erlaubten Spielzüge (Super Mario: Nach rechts laufen, springen usw.) vorgegeben, das eigentliche Spiel erlernen die Agenten durch gezieltes und millionenfaches Ausprobieren (Super Mario) bzw. Spielen gegen sich selbst (AlpaGo Zero).

- Industrielle Anwendungsgebiete für Reinforcement Learning sind beispielsweise Roboter, denen nur das Ziel vorgegeben wird und welche die dafür notwendigen Bewegungen durch gezieltes Ausprobieren erlernen (z.B. lernen Roboter Türen zu öffnen).

Abbildung 4 fasst die genannten Beispiele zu Regression, Klassifizierung und Clusterbildung bildlich zusammen.

Deep Learning (DL)

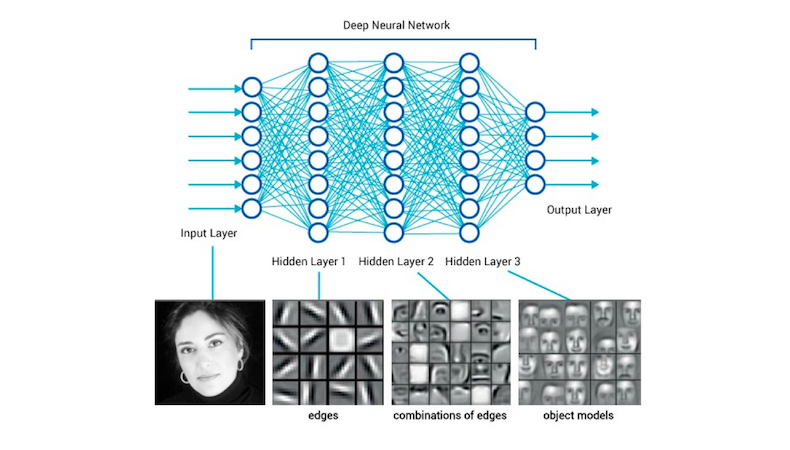

Deep Learning ist das Teilgebiet das Machine Learning, welches sich auf die Nutzung bestimmter Lernalgorithmen, den tiefen neuronalen Netzen (engl. Deep Neural Networks, DNNs) fokussiert.

Neuronale Netze sind in ihrer Funktionsweise lose an die Funktionsweise von Neuronen in unserem Gehirn angelehnt. Der Begriff “tief” entspringt der Eigenschaft, dass sehr viele Schichten von künstlichen Neuronen hintereinandergeschaltet werden. Im Endeffekt stellen Neuronale Netze aber auch “nur” bestimmte mathematische Modelle dar, die für die oben genannten Machine Learning Aufgaben verwendet werden können. Dabei haben sie folgende relevante Eigenschaften:

- Sie können quasi beliebige mathematische Funktionen wiedergeben. Daraus ergeben sich zwei Vorteile:

- Die am besten passende Funktion muss nicht mehr manuell ermittelt werden.

- Inputdaten müssen im Vergleich zu klassischen Methoden weniger aufwendig vorverarbeitet werden (insbesondere fällt das „Feature Engineering“, die manuelle Suche nach den besten Inputvariablen, oft weg) – das Neuronale Netz “sucht” sich sozusagen den relevanten Teil der Inputdaten selbst zusammen.

- Das Trainieren benötigt viele Daten und eine große Rechenkapazität, auch deshalb sind sie der Gewinner des aktuellen KI-Hypes (vgl. Abbildung 2).

Das Prinzip ist in Abbildung 5 am Beispiel einer Gesichtserkennung vereinfacht dargestellt: In den ersten “unteren” Schichten extrahiert das DNN einfache Features wie Ecken und Kanten. Je näher wir der Ausgabeschicht (Output Layer = Vorhersage) kommen, desto komplexer und problem-spezifischer werden die extrahierten Objekte/Features, bis am Ende komplette Modelle verschiedener Gesichter extrahiert werden. Ein echtes DNN zur Erkennung von Gesichtern eine große Anzahl an verdeckten Schichten und bis zu 8 Millionen zu erlernende Parameter.

Fazit: Was ist Ihre Meinung?

Trotz (oder wegen) des aktuellen Hypes um KI lohnt es sich immer wieder klarzumachen: Am Ende sprechen wir immer über eine (sehr raffinierte) Art und Weise einer mathematischen Optimierung – auch Deep Learning ist, etwas überspitzt gesagt, nur eine komplexe Variante der linearen Regression. Die Maschinen sind daher eigentlich ziemlich dumm. Sie können nur das, wozu wir sie trainieren.

Das sollten wir uns gerade bei aufgeheizten Debatten, wie denen über Killer-Roboter (z.B. Tod durch Roboter, FAZ.net am 07.12.2017) oder die drohende Massenarbeitslosigkeit durch KI (z.B. Welche Jobs und Berufe künftig überflüssig werden, welt.de am 18.04.2016) immer wieder ins Gedächtnis rufen:

Sind nicht wir es, die entscheiden, für welche Zwecke Maschinen und Algorithmen eingesetzt werden? Diese Verantwortung können und dürfen wir nicht an Computer abgeben.

Da die heutigen Anwendungsmöglichkeiten dennoch sehr beeindruckend und auch für das Marketing höchst relevant sind, widmen wir uns im nächsten Blogpost dediziert einigen spannenden Deep Learning Use Cases und insbesondere den Implikationen der Technologie für zukünftiges Marketing.

- Was meinen Sie?

- Ab wann ist aus Ihrer Sicht eine Maschine intelligent?

- Ist Ihnen bereits ein solcher Deep Learning Use Case im Marketing bekannt? Erzählen Sie uns in einem Kommentar gerne mehr darüber.

Bei Fragen oder Anregungen freuen wir uns über Kommentare zu diesem Post.

7 Antworten

Ich finde die Erforschung von künstlicher Intelligenz äusserst sinnvoll.

Ich denke auch, dass diese besonders im deutschen Bundestag bei einigen Politikern recht hilfreich wäre.

Hallo Frau Tafolli,

bei den aktuellen Trainingsdaten bin ich mir nicht sicher, was da herauskommen würde…

Ich vertraue weiterhin auf die menschliche Intelligenz!

Viele Grüße

Unweigerlich wird sich die Intelligenz auch künstlich weiter entwickeln.

Bei machen Dingen und Fragestellungen ist das sicher sinnvoll und gut, weil es Ressourcen schont (effiziente Arbeitsprozesse durch Roboter), Zeit einsparen hilft (Apps für online Verkehrsdatenmeldungen) und das Leben sicherer macht (Onlinewegweiser für Patienten: welcher Arzt / Spital operiert am besten) Unweigerlich verbunden damit ist aber auch die Frage, inwieweit der Mensch von den kleinen Geräten und Apps abhängig und entmündigt wird (siehe Buch “Smarte Diktatur” von Prof. H. Walzer und Artikel von Eduard Kaeser in der NZZ am Sonntag / 16.9.2018).

Darin werden die Grenzen der Machbarkeit und Abhängigkeiten deutlich, die zu überlegen sind. Ansonsten haben wir bald eine smarte Diktatur… oder hat die bereits begonnen ;o) ??

Hallo Frank,

danke für Deinen Kommentar. Ich denke nicht, dass dieses Thema neu ist und in irgendeiner Form von der (gar nicht so neuen) Technologie des maschinellen Lernens (=KI) abhängt. Ähnliche Effekte und Fragestellungen kann man doch bei jeder neuen Massentechnologie beobachten (Dampfmaschinen/Autos, Telefonie, Fernsehen, Internet usw.). Aufhalten lässt sich der technologische Fortschritt aus meiner Sicht sowieso nicht.

Ich würde mir eher wünschen, dass sich ein Paradigmen-Wechsel im Sinne von Morevecs Paradoxon vollzieht (siehe Wikipedia): Lasst uns Technologie für das einsetzen, was wir nicht gut können und woran wir keinen Spaß haben. Alles andere tun wir weiterhin selbst und haben zukünftig sogar noch mehr Zeit dazu.

Bleibt weiterhin spannend 🙂

Viele Grüße